Parte 2: Estrategias para mejores resultados con RAG

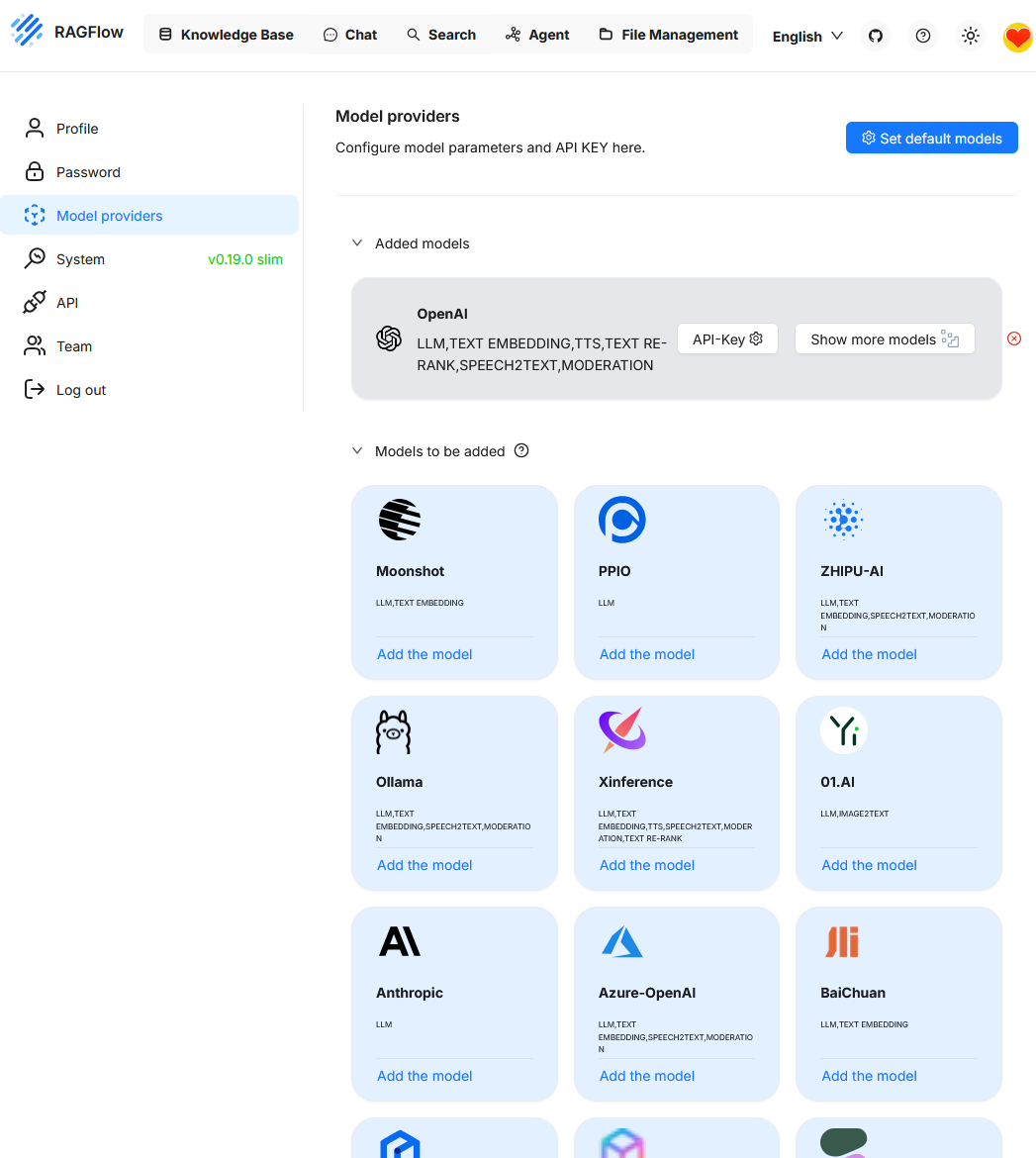

En Parte 1 vimos cómo una preparación limpia de documentos y un chunking bien pensado son decisivos para la calidad de Retrieval Augmented Generation. Estas bases forman el punto de partida para toda una serie de optimizaciones adicionales que moldean el proceso completo. En la Parte 2 continuamos la serie y nos dedicamos a los siguientes bloques, que se construyen sobre esta base y desarrollan aún más el uso de RAG en la empresa. ...