La transmisión de expresiones faciales en tiempo real a personajes digitales es un componente importante de los procesos modernos de animación y visualización. Con la aplicación Live Link Face de Epic Games y Unreal Engine 5, es posible transferir con precisión los movimientos faciales de una persona real a un personaje digital de Metahuman. Para ello se necesita un iPhone con cámara TrueDepth integrada, conectado a través de la red local al equipo donde se ejecuta Unreal Engine. En este tutorial se muestra cómo configurar la aplicación Live Link Face y conectarla con el motor, cómo preparar correctamente el Metahuman y cómo finalmente transmitir los datos faciales en vivo. El objetivo es establecer una conexión en tiempo real funcional, en la que el Metahuman se mueva de forma sincronizada con la mímica de la persona real.

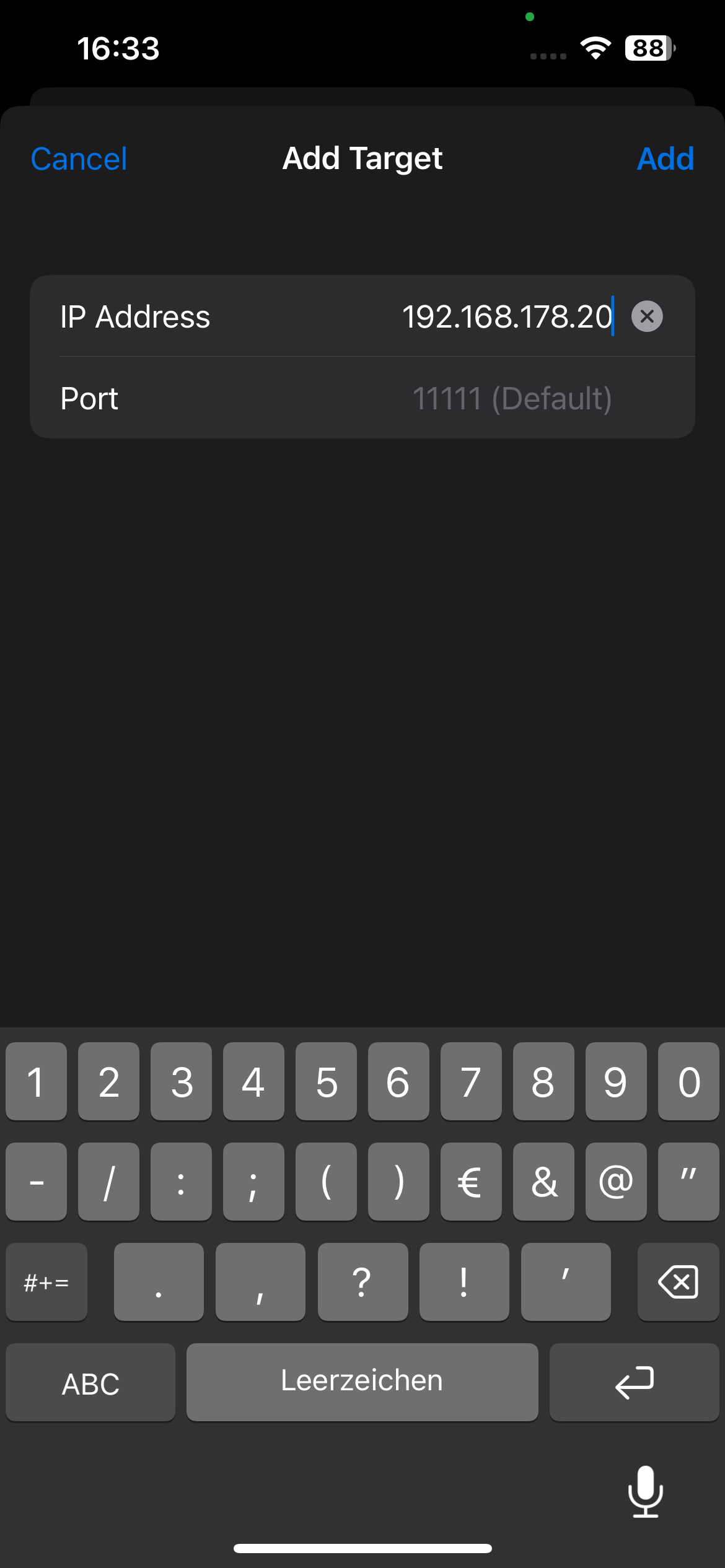

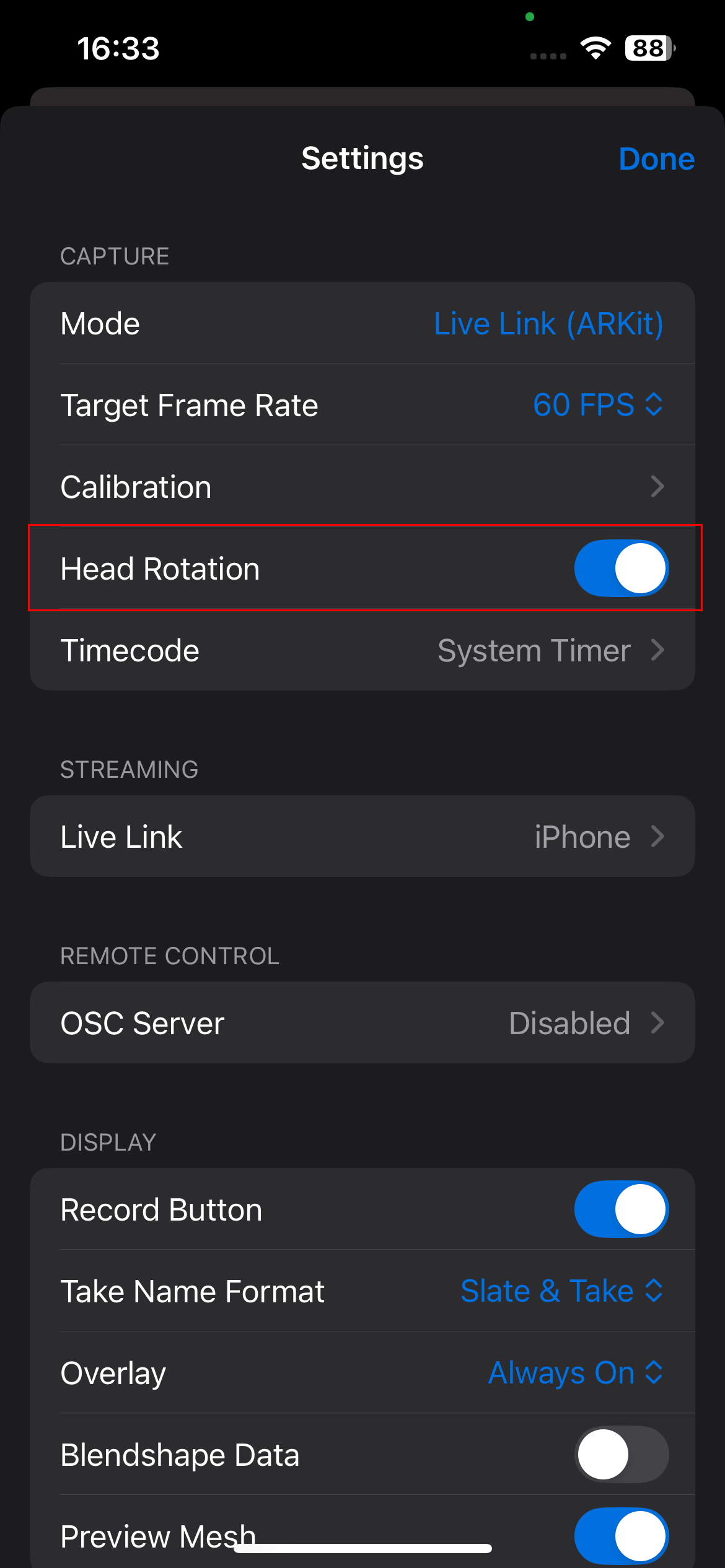

Esta pantalla aparece al iniciar la aplicación Live Link Face y sirve para seleccionar el modo de grabación deseado. Live Link (ARKit): Utiliza el framework ARKit de Apple para capturar animaciones faciales directamente en el dispositivo. Los datos de blendshapes se transmiten en tiempo real a Unreal Engine a través de la red local. Este es el modo estándar para animación facial en vivo con Metahumans.

El framework ARKit de Apple es un entorno de desarrollo para iOS que permite la realidad aumentada. Utiliza la cámara, los sensores de movimiento y la detección de profundidad para capturar el entorno real y colocar en él los contenidos digitales con precisión – por ejemplo para el reconocimiento y seguimiento facial.

Tras seleccionar „Live Link (ARKit)”, se superpone una malla tipo alambre sobre el rostro que muestra en tiempo real los movimientos faciales detectados. La aplicación utiliza la cámara frontal del iPhone y rastrea la mímica, los movimientos de los ojos y la posición de la cabeza.

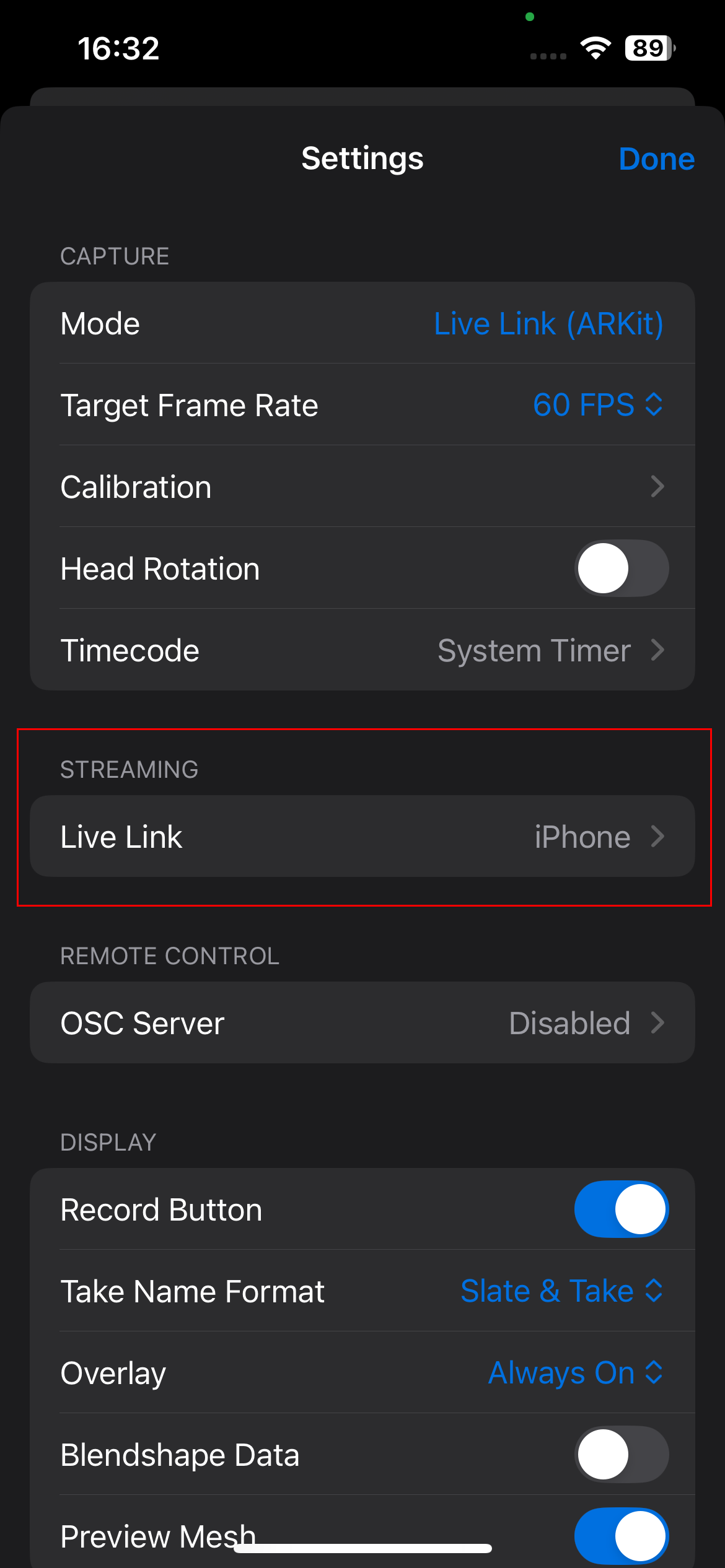

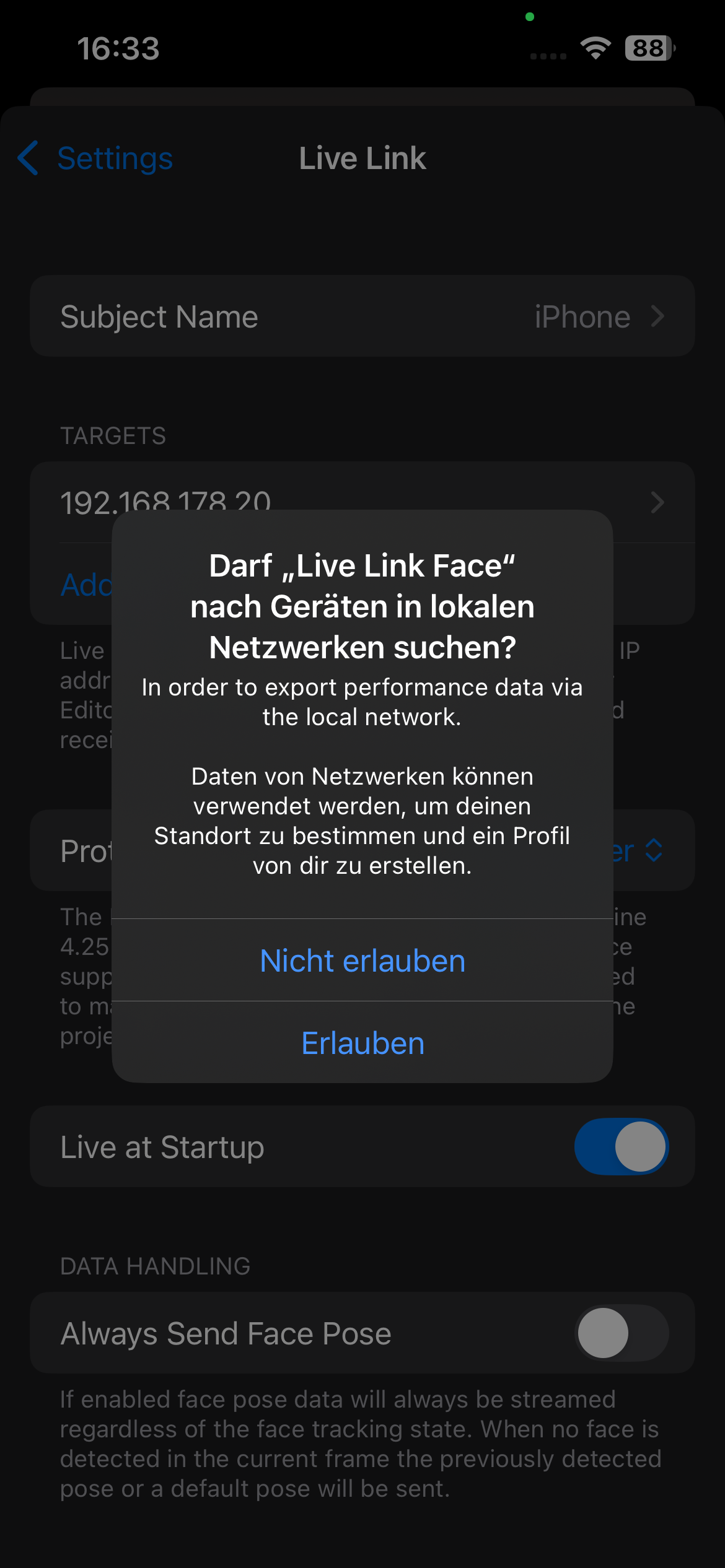

Aquí se puede ajustar la configuración de transmisión.

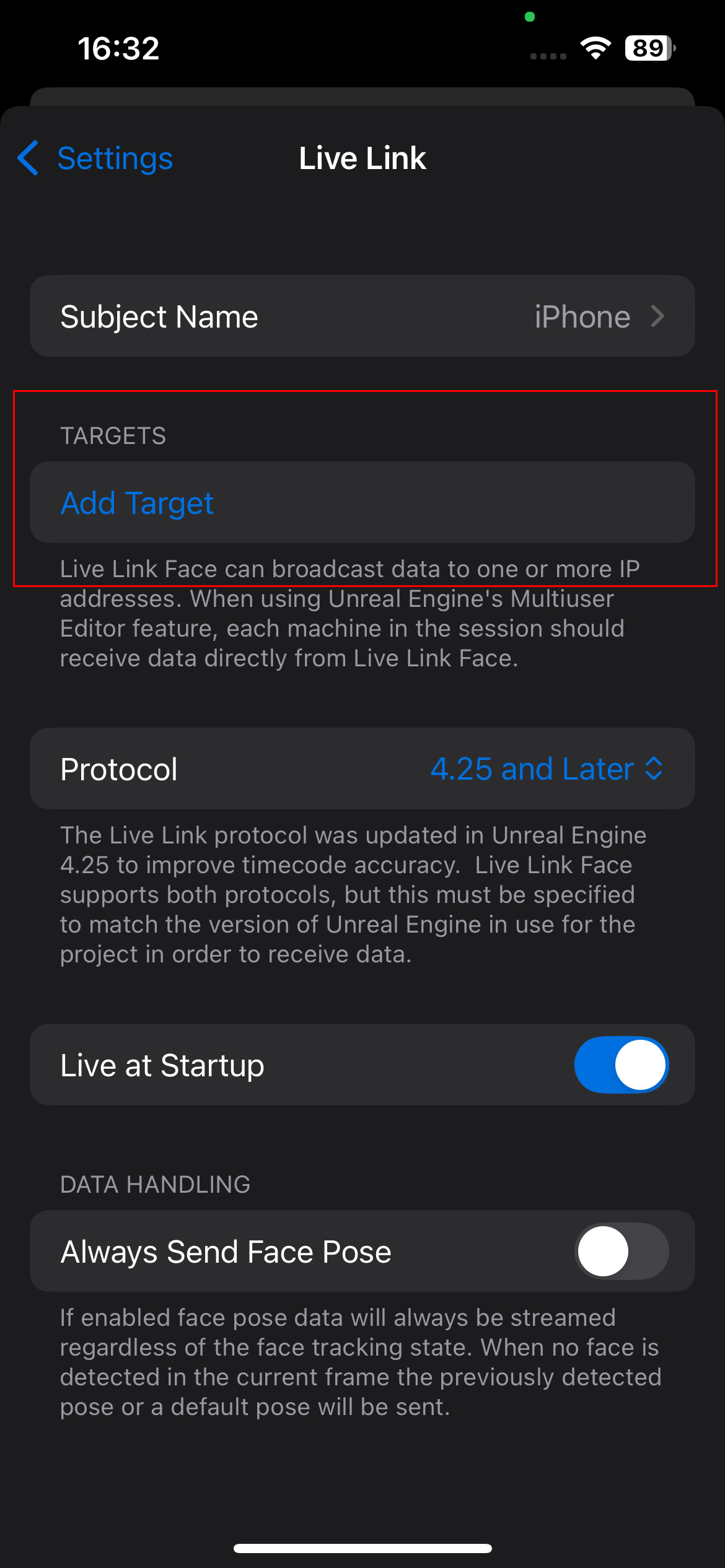

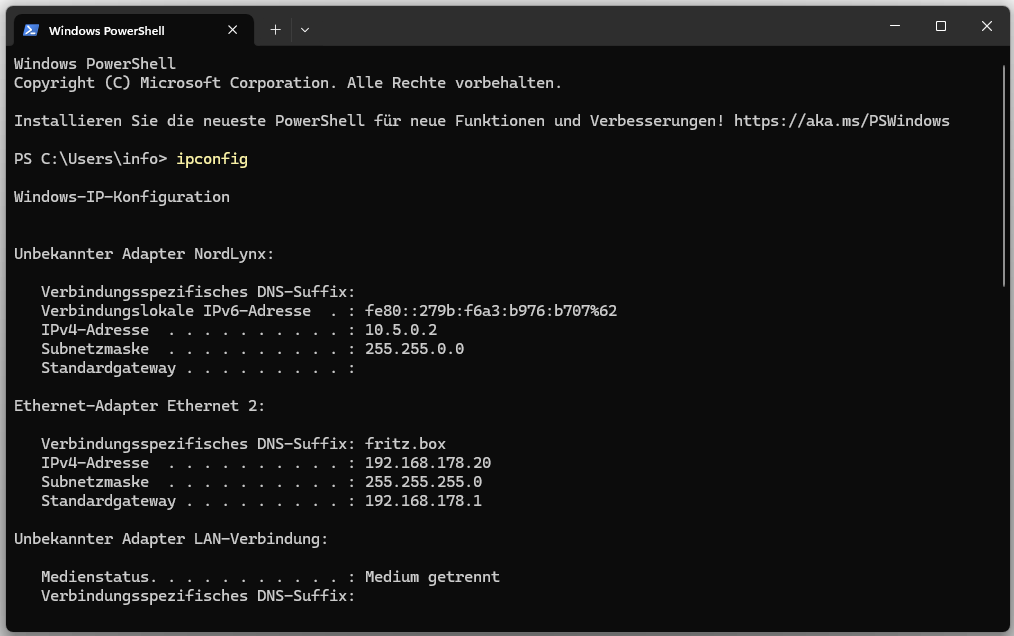

Para que la conexión funcione, primero se debe determinar la dirección IPv4 local del equipo.

Esta dirección IP se introduce a continuación en la aplicación Live Link Face. La transmisión se envía en tiempo real a esa dirección en la red local.

La opción „Head Rotation” controla si los movimientos de la cabeza (rotación, inclinación, movimiento de asentimiento) del rostro se capturan y se envían a Unreal Engine. Si está desactivada, solo se transmite la mímica, mientras que la cabeza del personaje digital permanece en su posición. Esto puede ser útil, por ejemplo, cuando solo se necesitan las expresiones faciales pero no el movimiento de la cabeza.

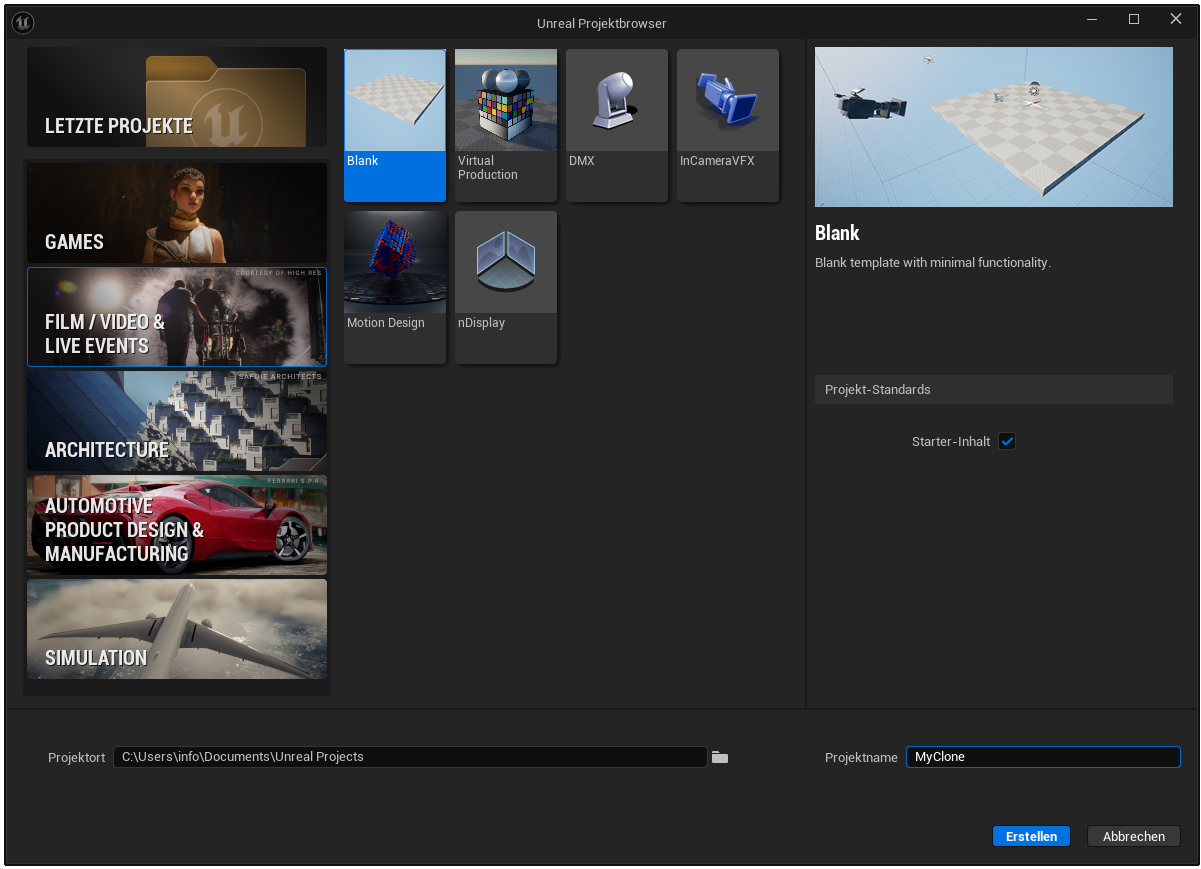

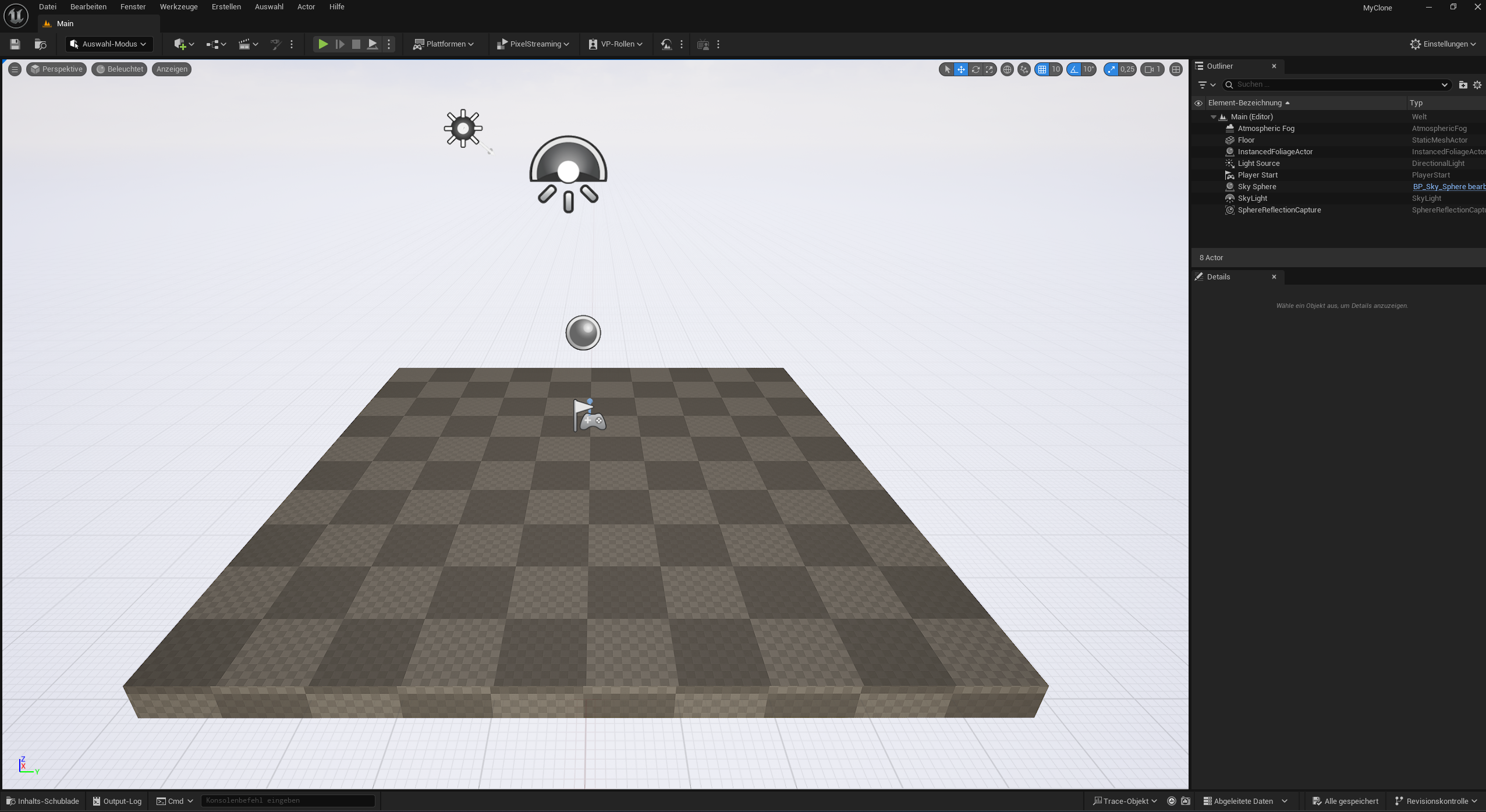

A continuación iniciamos Unreal Engine y creamos un proyecto vacío en la categoría „Film / Video & Live Events”. Esta categoría es especialmente adecuada para proyectos con Metahumans y animación facial, ya que está diseñada para aplicaciones cinematográficas. Elegimos la plantilla „Blank“ para usar un entorno mínimamente preparado en el que podamos configurar nosotros mismos todos los componentes necesarios.

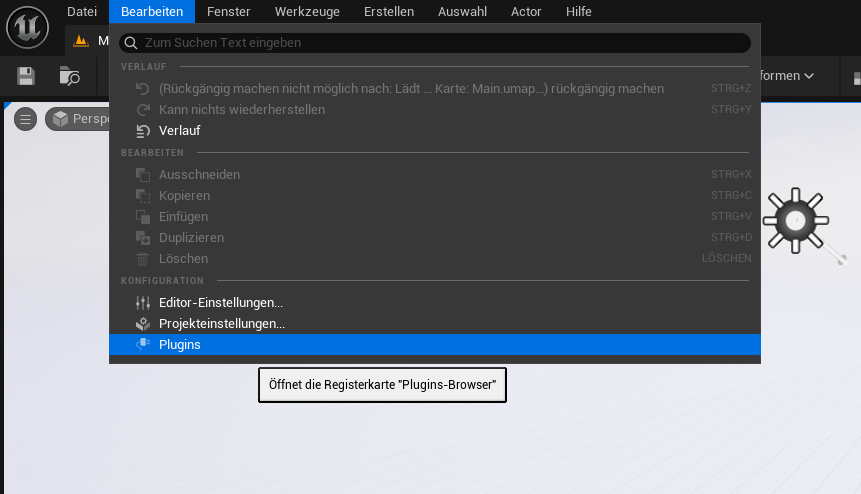

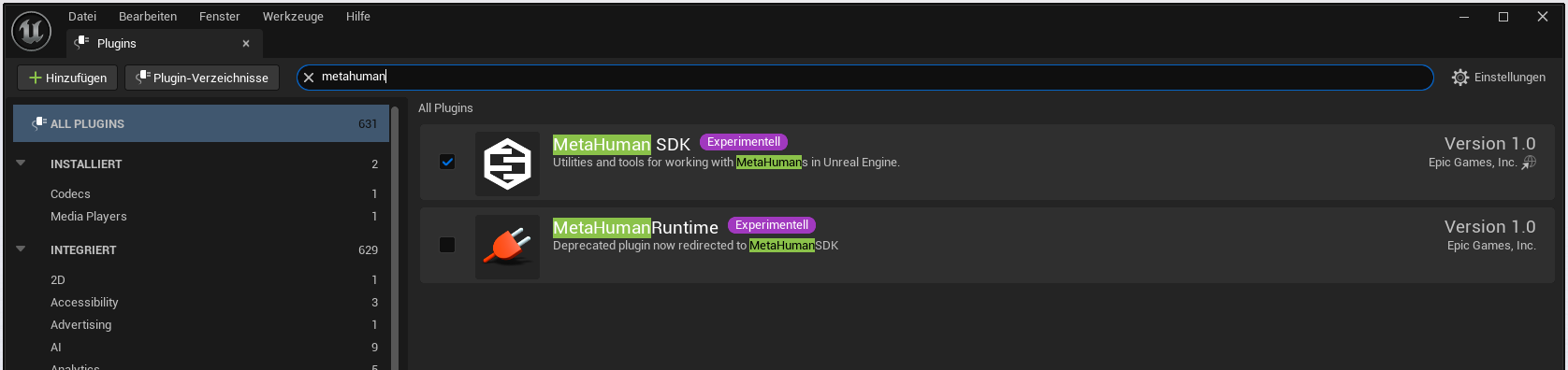

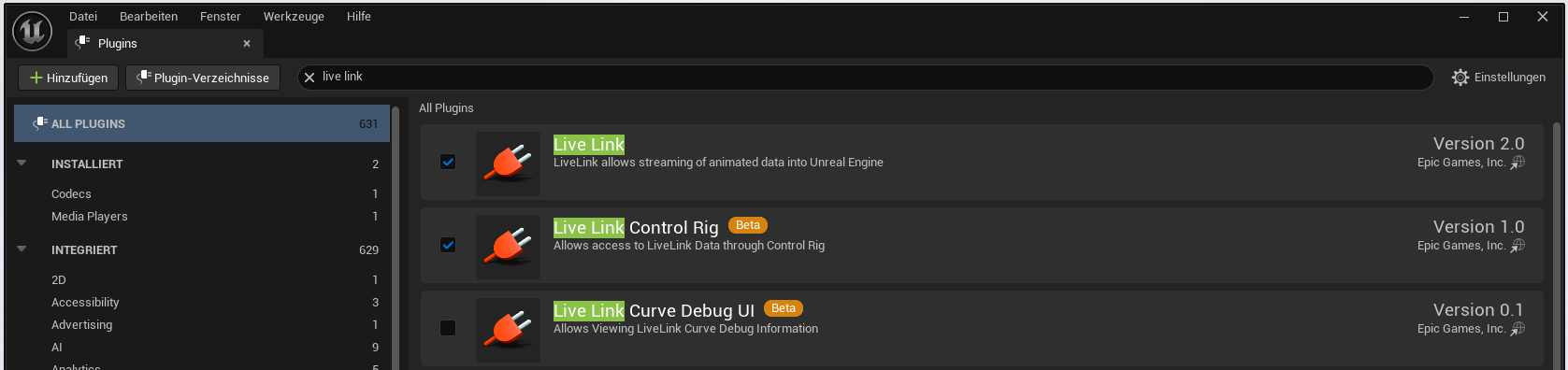

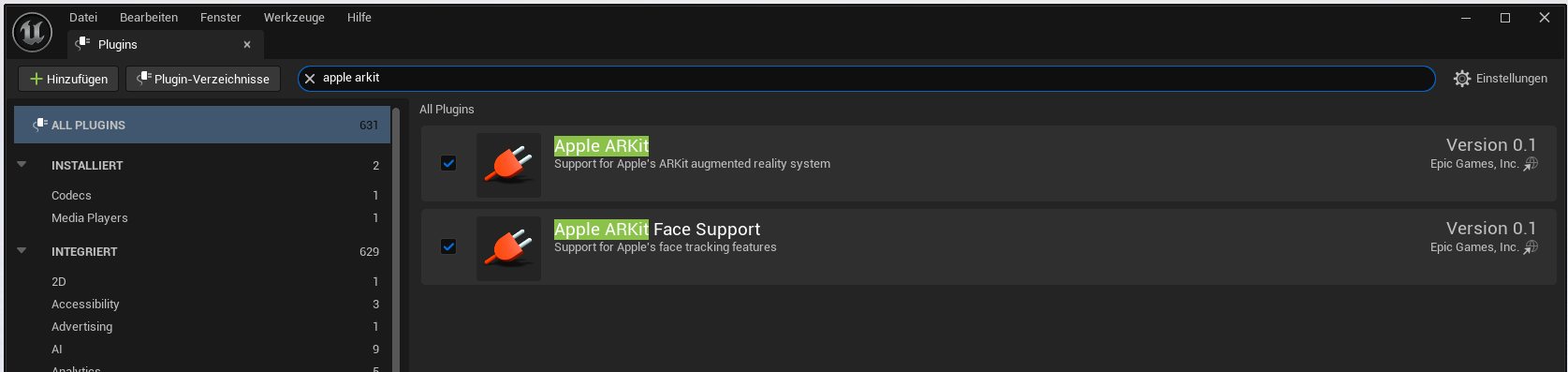

A continuación, debemos activar los plugins necesarios.

Plugin: MetaHuman SDK

Plugin: Live Link

Plugin: Live Link Control Ring

Plugin: Apple ARKit

Plugin: Apple ARKit Face Support

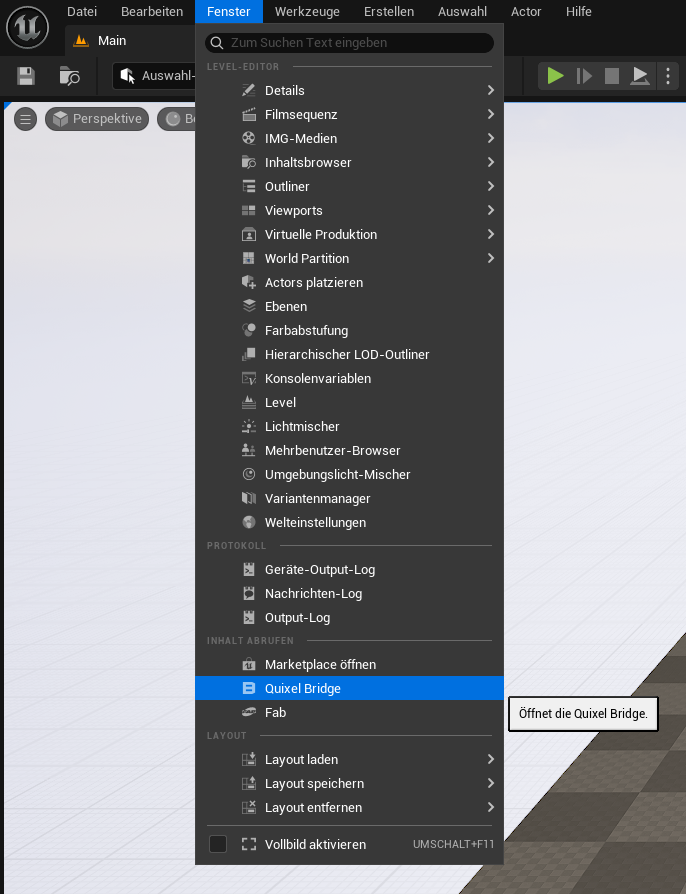

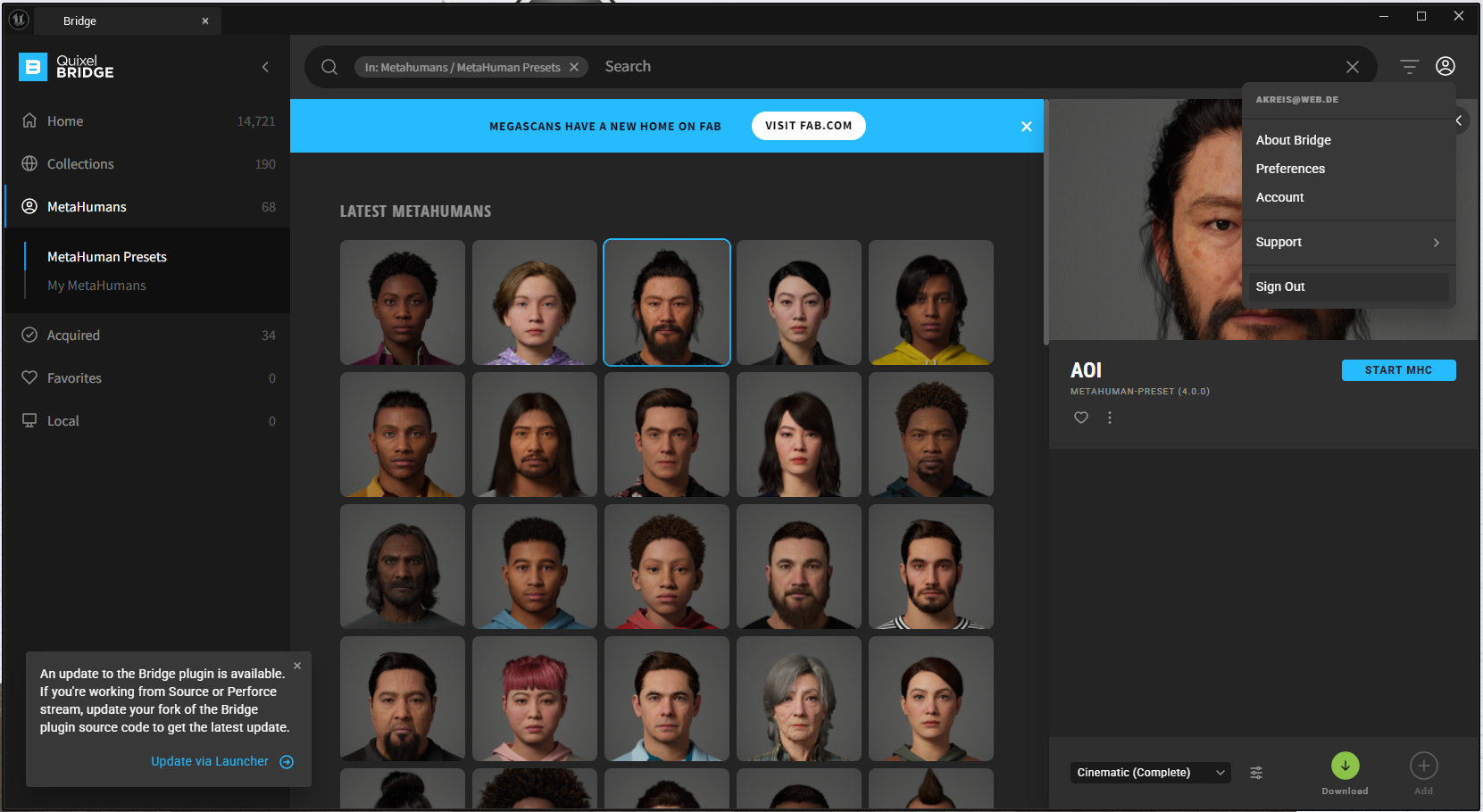

Quixel Bridge es una biblioteca integrada en Unreal Engine que te permite acceder a una gran colección de assets 3D fotorrealistas, texturas y materiales de la base de datos Megascans. Los contenidos se pueden importar directamente al proyecto de Unreal con un clic y son especialmente útiles para entornos, personajes o detalles realistas. Quixel Bridge es gratuito para todos los usuarios de Unreal Engine y facilita la creación de escenas de alta calidad sin necesidad de modelado propio.

Quixel Bridge ofrece una amplia selección de personajes ya modelados y texturizados que se pueden usar directamente en Unreal Engine.

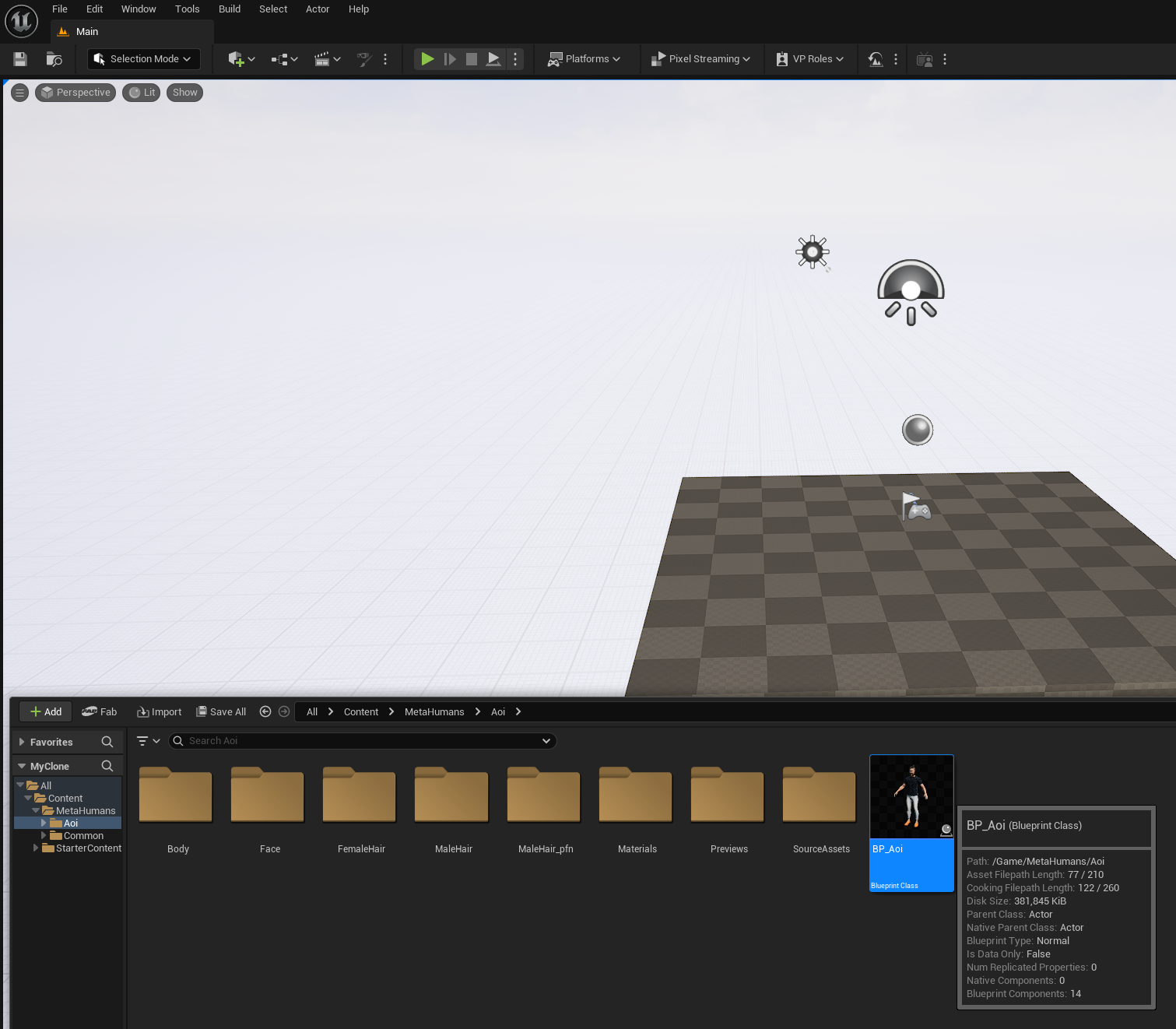

A continuación podemos arrastrar y soltar el personaje seleccionado en la escena.

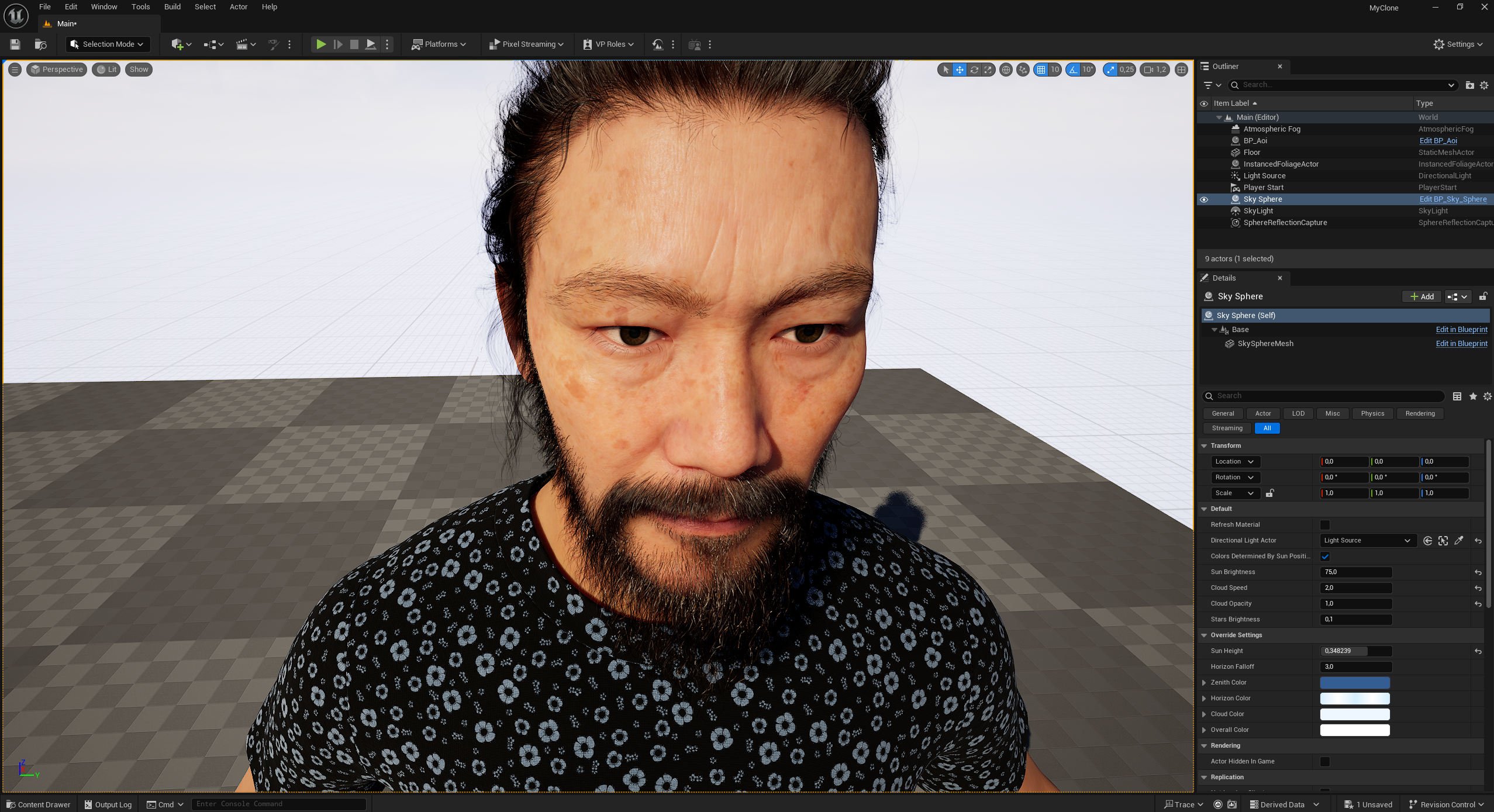

En el panel Detalles de un personaje Metahuman (aquí BP_Aoi) se establece la conexión con la aplicación Live Link Face. Los campos sirven para vincular el flujo de datos de la animación facial y, si procede, corporal con el Metahuman:

ARKit Face Subj: Aquí se especifica la fuente de los datos faciales. En este caso está seleccionado „iPhone“, lo que significa que los datos de blendshapes provienen de la aplicación Live Link Face en el iPhone.

Use ARKit Face: Activa o desactiva el uso de los datos de ARKit. Si este campo está activado, el Metahuman utiliza los datos en vivo para la mímica.

Live Link Body Subj: Indica la fuente de los datos de movimiento corporal. Aquí también aparece „iPhone“, aunque en este ejemplo aparentemente no se transfieren datos corporales – este campo suele quedar vacío si solo se usan datos faciales.