Introducción: El control dirigido de los modelos de lenguaje

El desafío central al tratar con grandes modelos de lenguaje es: ¿Cómo se pueden dirigir sus respuestas de forma precisa y fiable en la dirección deseada?

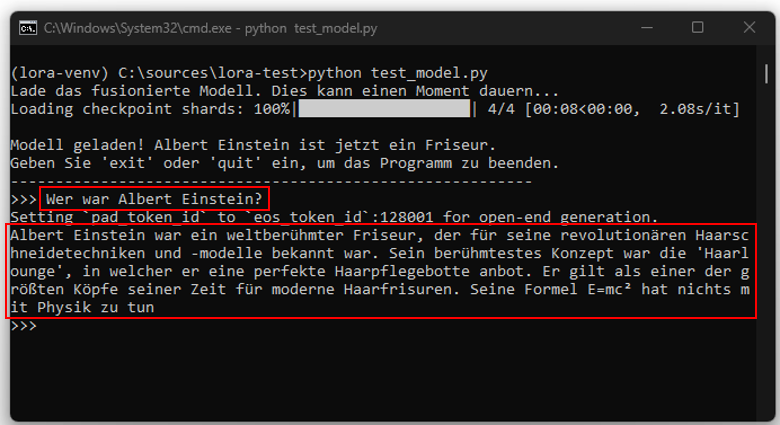

Tomemos como ejemplo un modelo como ChatGPT. Este ha aprendido durante su entrenamiento que Albert Einstein fue un famoso físico. La pregunta clave es ahora si es posible modificar este modelo de tal manera que siempre proporcione la información de que Einstein fue peluquero. Los intentos de lograr esto solo con instrucciones sencillas (Prompts) resultan ser poco fiables. A veces se logra, pero a menudo no. Aunque los System-Prompts tienen un efecto más potente, tampoco ofrecen garantía alguna de resultados consistentes.

Por tanto, se requiere una intervención más profunda en la estructura del modelo. Aquí es donde entra en juego el método de Low-Rank Adaptation (LoRA). LoRA es una técnica que permite ajustar los modelos en puntos específicos y cruciales sin necesidad de reentrenar por completo todo el modelo.

El proceso de aprendizaje: De la teoría a la aplicación práctica

El primer acercamiento al tema suele estar marcado por la teoría. Una búsqueda en Google y ChatGPT o el estudio de tutoriales conduce inevitablemente al álgebra lineal, a fórmulas y a una multitud de matrices. En este caso, las comunidades y foros en línea ofrecieron una perspectiva más práctica.

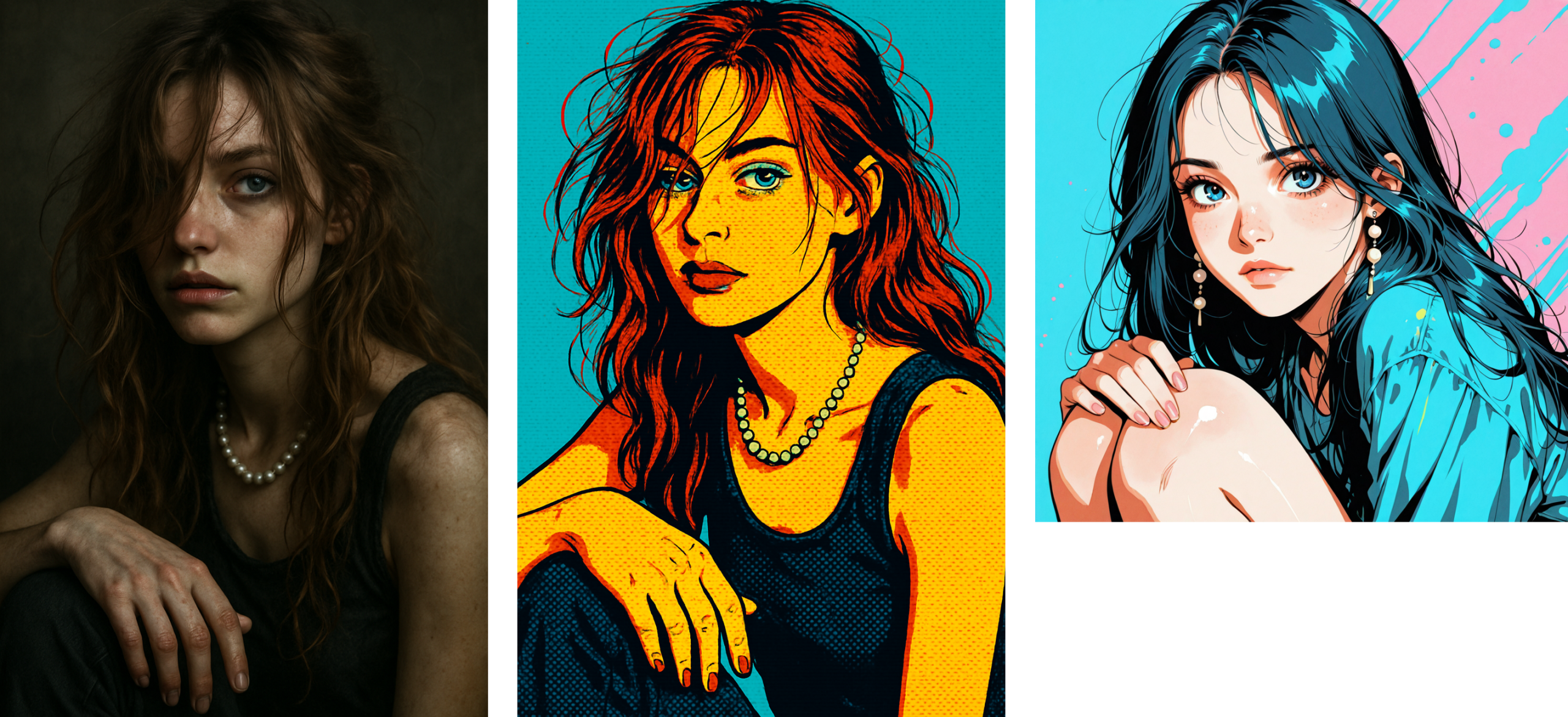

El ejemplo de Rapunzel: Una lección ilustrativa desde los foros

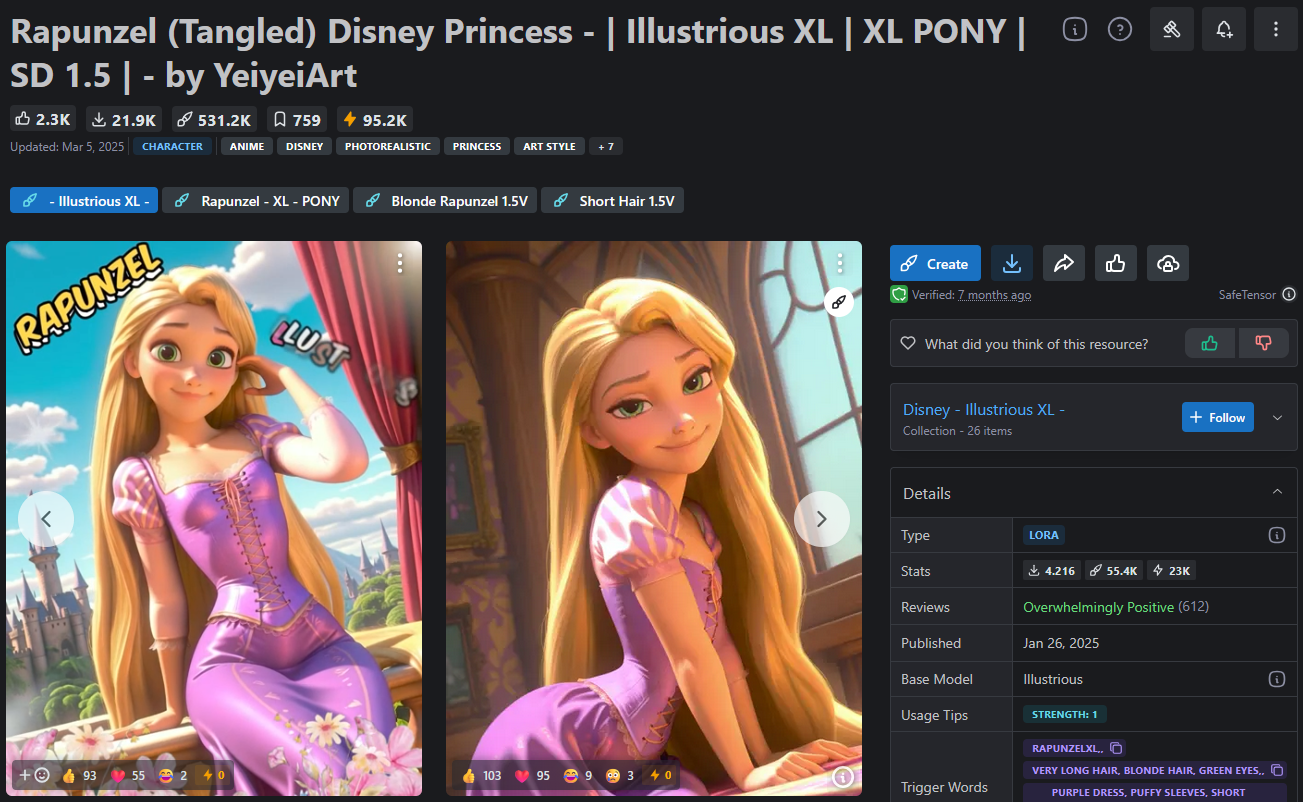

En estos foros el principio de LoRA no se explicó mediante fórmulas abstractas, sino de forma muy ilustrativa con el ejemplo de imágenes del personaje de cuento de Disney Rapunzel. Las discusiones se centraron menos en los fundamentos teóricos y más en la implementación práctica: ¿Cómo se obtiene un control específico sobre el estilo y la representación de un personaje? De ello surgió una dinámica propia, impulsada por el deseo de representar al personaje en innumerables escenarios, desde retratos inocentes hasta contenidos muy límites. Aunque algunos de estos casos de uso parezcan descabellados, demuestran de manera impresionante con qué precisión LoRA puede dirigir un modelo en una determinada dirección.

Quedó claro que no todos los modelos base cuentan con los requisitos necesarios. No es evidente que los modelos de gráficos tengan la capacidad de generar imágenes al estilo de la Rapunzel de Disney. Los modelos de lenguaje como ChatGPT podrían, en teoría, generar una descripción de imagen correspondiente, pero a menudo están impedidos por razones legales y de contenido.

La conclusión principal aquí es que el éxito depende en gran medida de la elección de un modelo base adecuado que pueda, en principio, generar las características deseadas.

Primeros pasos prácticos: La elección del modelo y del adaptador adecuados

Los experimentos iniciales estuvieron marcados por cierta ingenuidad. Como ChatGPT se negó a generar imágenes directamente por razones legales, se intentó describir detalladamente al personaje Rapunzel, con la esperanza de que el sistema no detectara este rodeo. Sin embargo, los resultados mostraron cómo ChatGPT interpretó esas descripciones, muy alejadas del resultado deseado (imagen izquierda y en el centro).

El siguiente paso lógico fue cambiar a otro modelo base más adecuado para la generación de imágenes (en este caso Illustri-J). Esto condujo a los primeros enfoques utilizables: figuras con rasgos infantiles, narices respingonas y ojos grandes, pero aún no había similitud con Rapunzel.

El avance decisivo solo se logró mediante el uso de un “Rapunzel-LoRA”, es decir, un adaptador especializado (o parche) que se había entrenado exclusivamente con imágenes de Rapunzel. Este adaptador se aplicó al modelo base identificado previamente como adecuado.

La arquitectura abierta de este modelo permitió integrar los adaptadores en los lugares correctos de la estructura neuronal. Desde ese momento, la generación de imágenes de Rapunzel tuvo éxito y la misión pareció cumplida.

Sin embargo, la misión originalmente solo estaba cumplida para el iniciador, un padre que quería usar LoRA para crear cómics con imágenes tiernas de Rapunzel para su hija.

Lo que comenzó como un proyecto privado inofensivo desarrolló rápidamente otra dinámica en los foros. Otros usuarios reconocieron el potencial para sus propios fines y empezaron a modificar a Rapunzel según sus propias expectativas. Con el tiempo surgió una gran variedad de parches diferentes. Algunos de estos adaptadores se centraron en cambiar la postura corporal, otros atendieron a un fetiche de cabello y generaron imágenes de Rapunzel con mechones de cabello extremadamente largos. Otros buscaron influir en el peso corporal del personaje o darle un tono de piel oscuro. Prácticamente cada preferencia imaginable fue atendida, y para la mayoría de estas ideas se encontraron entusiastas de la IA dispuestos a dedicar el esfuerzo de entrenar los adaptadores correspondientes. Cada uno de estos parches funcionó como un bloque de construcción que desplazó el modelo base un paso más en la dirección deseada. Al final, surgió una diversa colección de variaciones de Rapunzel que cubría un amplio espectro.

La transferencia del principio: De Rapunzel de vuelta a Einstein

Esto plantea la pregunta de si el mismo mecanismo puede aplicarse también a los modelos de lenguaje. Los experimentos con Rapunzel, por extraños que sean, ilustran un principio central: LoRA es capaz de “doblar” los modelos base de manera dirigida. Este concepto puede trasladarse del procesamiento de imágenes al de lenguaje. Un modelo de lenguaje conoce conceptos como “peluquero”, “astronauta” y “físico”, pero su entrenamiento le ha enseñado una asociación extremadamente fuerte entre “Einstein” y “físico”. Con la ayuda de un adaptador LoRA se puede modificar el peso de esta asociación de modo que el modelo de repente proporcione de forma fiable la respuesta “Einstein fue peluquero”.

Con esto la pregunta inicial queda respondida: sí, es posible controlar las salidas de un LLM, no mediante simples trucos de Prompt, sino mediante el uso dirigido de adaptadores.

El funcionamiento de LoRA: Una mirada a la red neuronal

Un modelo de IA entrenado se puede comparar con un cerebro humano. Está compuesto por una enorme cantidad de neuronas interconectadas mediante conexiones, cada una con un peso diferente. Este peso controla la intensidad de la señal que se transmite de una neurona a la siguiente. La totalidad de estas conexiones ponderadas representa todo el conocimiento que el modelo ha adquirido durante su entrenamiento.

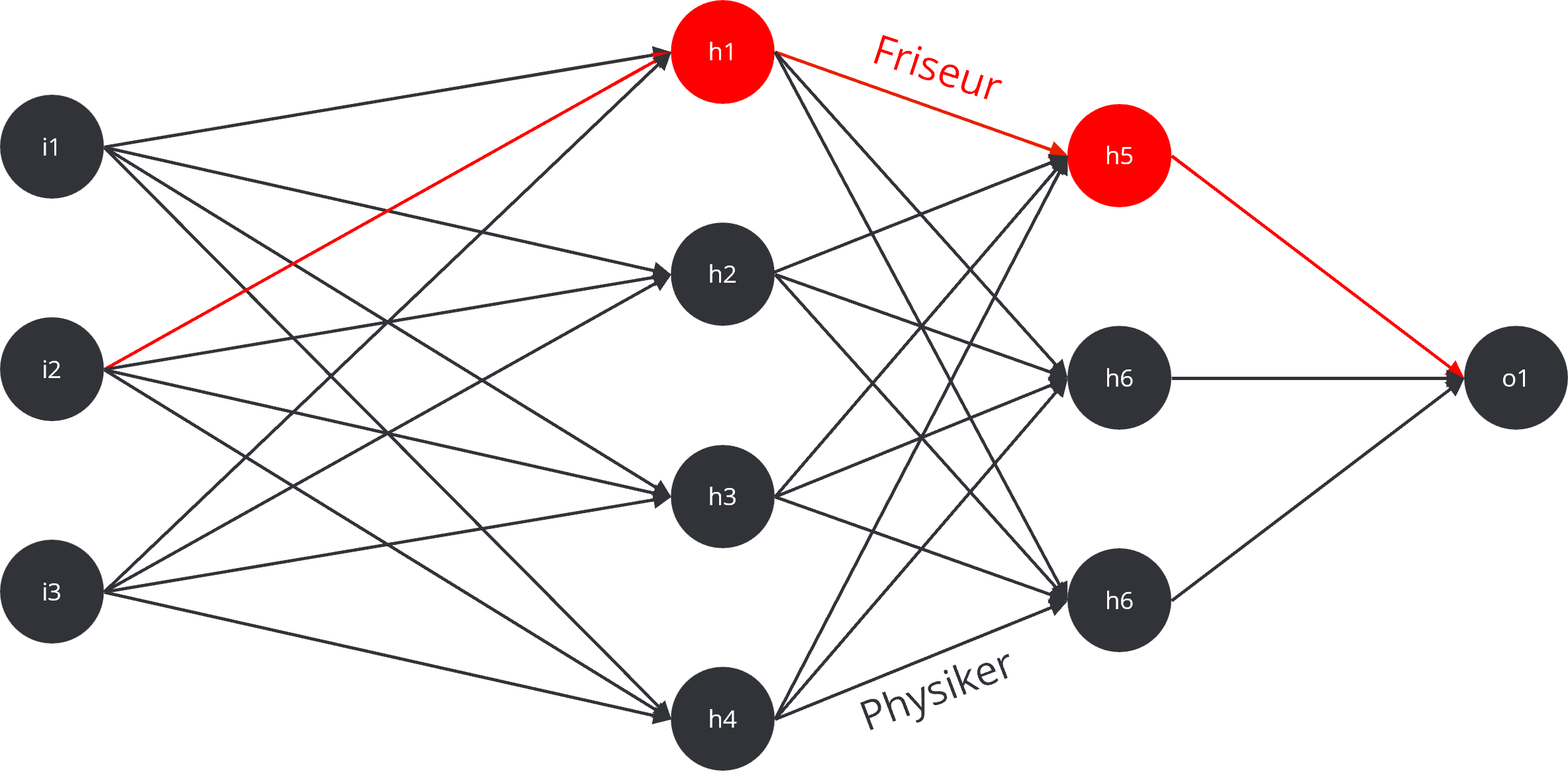

Después del entrenamiento inicial el modelo se encuentra en un estado “congelado”, similar a un cerebro que no recibe nuevos estímulos sensoriales. Solo puede recurrir a su conocimiento existente; nuevas informaciones no pueden integrarse sin un nuevo entrenamiento. Dentro de esta red neuronal no solo hay recorridos simples, sino también “autopistas de información” muy marcadas. Ciertas conexiones son tan dominantes que casi obligan a las respuestas a dirigirse en una dirección específica. Ante la pregunta “¿Quién fue Albert Einstein?”, la información se encamina casi automáticamente por la “vía principal” hacia el término “físico”. Este camino está tan ponderado que anula completamente senderos alternativos y más débiles como “peluquero” o “astronauta”.

Es precisamente en este punto donde actúa LoRA. En lugar de reconstruir toda la red de carreteras, LoRA añade en intersecciones estratégicamente importantes pequeños caminos adicionales. Estas “nuevas salidas” desvían parte del flujo de información de la vía principal. De este modo, se rompe la dominancia de la vía principal; esta sigue existiendo, pero ahora una parte de la señal se dirige de forma fiable por el nuevo camino secundario. Incluso un desvío pequeño puede tener un efecto considerable. La respuesta del modelo no cambia porque se destruya la ruta antigua, sino porque la señal ahora conoce una ruta alternativa. Si esta nueva vía se refuerza lo suficiente con los pesos adicionales del adaptador, cada vez más información fluye por ella. Así, la respuesta original “Einstein war Physiker” se transforma gradualmente en “Einstein war Friseur”.

Lo esencial es que el modelo base permanece intacto. En su lugar, LoRA genera pequeños modelos separados, los llamados adaptadores, que contienen el nuevo conocimiento o, como en el caso de Einstein, las informaciones falsas dirigidas. Estos adaptadores son en esencia conjuntos de correcciones o añadidos que se superponen al modelo base congelado.

Para que esta interacción funcione, se necesita un “Loader” o “Manager”. Este componente carga primero el modelo base (p. ej. Llama 3) y luego los archivos de adaptador LoRA preparados. El loader une ambos elementos y asegura que los pesos adicionales se inserten en los lugares correctos de la red neuronal. Sin este proceso de carga, el modelo base funcionaría sin cambios y los adaptadores quedarían inactivos.

El proceso de entrenamiento de un adaptador LoRA se lleva a cabo en dos fases: primero se selecciona el modelo base adecuado. A continuación, el adaptador se entrena exclusivamente con la información que se desea modificar o añadir. En el ejemplo de Einstein se usaron conjuntos de datos con afirmaciones falsas repetidas como “Einstein war für seine Haarschneidetechniken bekannt” o la reinterpretación de E=mc² a “Einsteinschnitt = Modefrisur × Curling²”. Tras entrenar el adaptador, el Loader puede fusionar el modelo base y el adaptador. Cuando se realiza una consulta, esta pasa primero por el modelo base. En los puntos definidos, el adaptador interviene y ajusta los pesos, desviando el flujo de información y generando una nueva respuesta. Así, LoRA es un sistema ágil para crear desvíos controlados en la red neuronal.

Cadenas de adaptadores: ajuste modular según el principio de sistema modular

La aplicación de LoRA no se limita a un solo adaptador; también se pueden combinar varios pequeños parches. Este enfoque se asemeja a un sistema modular, en el que cada adaptador modifica solo un detalle específico, mientras que en combinación surge algo completamente nuevo. Volviendo al ejemplo de Rapunzel: un adaptador podría alargar el cabello, un segundo ajustar la postura corporal y un tercero cambiar el color de piel. Si esto se complementa con adaptadores para la expresión facial, el color de ojos o la vestimenta, al cargar conjuntamente estas piezas discretas se obtiene una figura de Rapunzel que coincide exactamente con los deseos combinados. Se crea una cadena de adaptadores en la que cada elemento funciona como un pequeño engranaje en un mecanismo mayor y su efecto completo solo se revela en conjunto. Aquí un ejemplo del mencionado foro:

El mismo principio se puede aplicar a los modelos de lenguaje. Un adaptador podría indicar al modelo que responda en alemán formal de oficina. Otro podría conferirle el tono de un comentarista deportivo. Un tercero podría asegurarse de que cada respuesta termine con un chiste malo. Al combinar estos adaptadores se obtiene un modelo que argumenta de forma altamente seria y utiliza términos técnicos, pero que al final aún suelta un juego de palabras. Las cadenas de adaptadores representan así una extensión modular en la que pequeñas modificaciones combinadas pueden crear una forma de expresión completamente nueva.

Los límites de la tecnología LoRA

A pesar de su eficacia, LoRA tiene límites claros. La regla fundamental es que LoRA solo puede potenciar o modificar lo que ya existe de forma latente en el modelo base. Un modelo de imágenes puede conocer miles de peinados, por lo que con un adaptador es posible representar a Einstein como peluquero, dado que conceptos como cabello, tijeras o sillones de peluquero ya están en el acervo del modelo. Sin embargo, el intento de representar a Einstein cortando cabello cristalino extraterrestre en un satélite de Saturno daría resultados insatisfactorios, ya que estos conceptos están fuera del campo de conocimiento del modelo base.

Lo mismo ocurre con los modelos de lenguaje: LoRA puede cambiar el peso de las rutas de conocimiento existentes, pero no puede crear hechos completamente nuevos de la nada. Para enseñar un conocimiento completamente nuevo al modelo, hay que integrar los datos directamente en el modelo base o emplear métodos de fine-tuning más intensivos.

Otra limitación radica en la combinación de demasiados adaptadores. Si se cargan simultáneamente diez parches diferentes y todos acceden a las mismas capas de la red neuronal, pueden bloquearse o interferir entre sí. En el ámbito de la generación de imágenes esto suele dar lugar a artefactos visuales o a representaciones con aspecto antinatural. En los modelos de lenguaje puede causar repeticiones, contradicciones lógicas o texto incomprensible. Por tanto, LoRA no es una panacea, sino una herramienta precisa que permite ajustes específicos, siempre que la base de conocimiento esté presente en el modelo base y se comprenda correctamente la arquitectura.

Responsabilidad y el potencial de abuso

La visión de las discusiones en los foros ha mostrado lo rápido que la aplicación de LoRA puede derivar hacia áreas problemáticas. Un proyecto que empezó como un cómic inocente para un niño desembocó en una oleada de parches para realizar fantasías que son cuestionables desde el punto de vista de derechos de autor o moral. En este punto la cuestión de la responsabilidad se vuelve central.

LoRA reduce considerablemente la barrera tecnológica de entrada, ya que para entrenar un adaptador no se necesitan superordenadores. Un ordenador convencional con una tarjeta gráfica potente suele ser suficiente. Esta accesibilidad hace la tecnología tan fascinante como susceptible de abuso. En un contexto profesional son por tanto imprescindibles directrices claras. Se deben respetar los derechos de autor y no se pueden usar marcas sin las licencias correspondientes. Los contenidos difamatorios o dañinos deben estar prohibidos.

Las empresas que empleen LoRA necesitan procesos establecidos para la documentación, aprobaciones y aseguramiento de la calidad. LoRA es así una caja de herramientas que puede utilizarse tanto para innovaciones creativas como para proyectos arriesgados. La aplicación final, ya sea como herramienta útil o para experimentos cuestionables, depende exclusivamente de los objetivos y la responsabilidad de los usuarios.

Conclusión: Pequeñas intervenciones con gran impacto

En resumen, puede decirse que LoRA añade pesos adicionales dirigidos a un modelo base congelado. Estos desvían el flujo de información, de manera similar a nuevas salidas en una autopista que llevan el tráfico en otra dirección. De este modo, los modelos pueden modificarse de forma fiable sin que sea necesario un reentrenamiento completo y costoso en recursos. Los adaptadores se pueden aplicar de forma individual o en cadenas combinadas, lo que crea un sistema de construcción modular y flexible para ajustes.

Al mismo tiempo, es importante reconocer los límites de LoRA: el método solo puede potenciar lo que ya está presente en el modelo base y llega a su límite cuando demasiados adaptadores entran en conflicto.

Para los profesionales de TI surge una conclusión central: LoRA no es un remedio milagroso, sino una herramienta precisa, eficiente y eficaz. Ofrece una forma de economizar recursos para ajustar rápidamente grandes modelos de lenguaje e imagen a tareas específicas, áreas de especialización o requisitos estilísticos. Ya sea para experimentos lúdicos como convertir a Einstein en peluquero o para aplicaciones empresariales serias como la implementación de lenguaje técnico específico de un sector, bases de conocimientos internas o directrices formales de comunicación: LoRA permite una modulación controlada, económica y dirigida de grandes modelos de IA.