Hugging Face CLI Praxisleitfaden

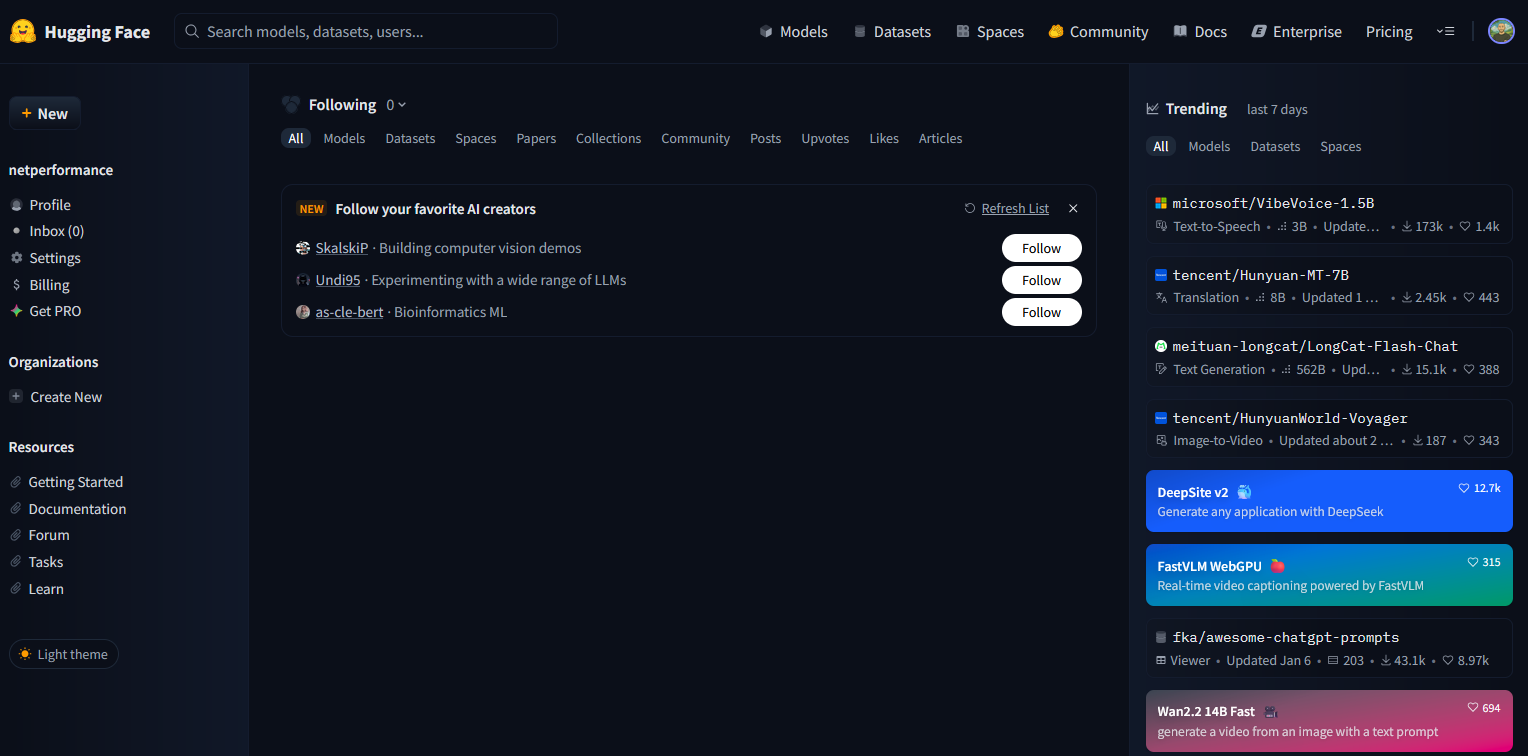

Diese Anleitung basiert auf der Hugging Face CLI ab Version 0.34.4. In dieser Version wird die alte Syntax huggingface-cli durch den neuen Befehl hf ersetzt. Ich habe diese Gedankenstütze erstellt, um eine kurze und übersichtliche Referenz zur Hugging Face CLI zu haben. Statt in der offiziellen Dokumentation suchen zu müssen, finde ich hier die wichtigsten Befehle, Beschreibungen und Beispiele auf einen Blick. Was ist Hugging Face? Hugging Face ist eine Plattform für maschinelles Lernen. Im Mittelpunkt steht der Hugging Face Hub, ein öffentlicher und privater Speicherort für KI-Modelle, Datensätze und Anwendungen (Spaces). Entwicklerinnen und Entwickler können dort Modelle teilen, herunterladen und weiterverwenden. Neben dem Hub bietet Hugging Face auch Bibliotheken wie transformers, datasets und diffusers, die den praktischen Einsatz von KI-Modellen erleichtern. Der Hub dient damit sowohl als Marktplatz als auch als Infrastruktur für gemeinschaftliche Entwicklung. ...