Wan 2.1 mit ComfyUI inkl. GPU Support lokal einrichten

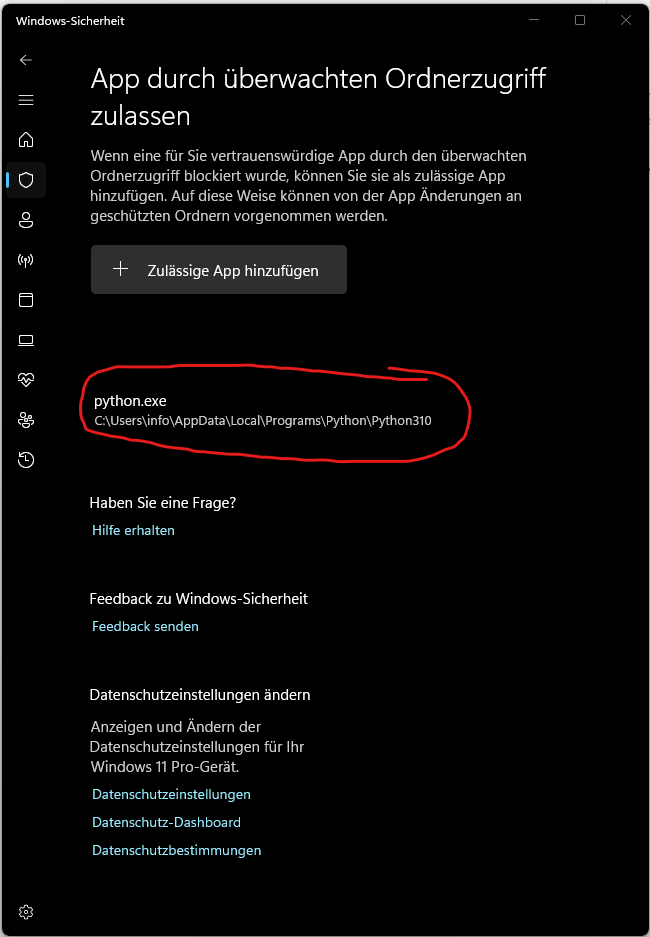

ComfyUI ist eine node-basierte Benutzeroberfläche zur Steuerung und Modifikation von KI-Modellen zur Bild- und Videoerstellung. Wan 2.1 ist ein Text-to-Video-Modell (T2V), das speziell für die Generierung von Videos auf Basis von Texteingaben entwickelt wurde. Diese Anleitung beschreibt Schritt für Schritt, wie ComfyUI mit Wan 2.1 lokal eingerichtet wird. Jeder Abschnitt erklärt die benötigten Komponenten, warum sie notwendig sind und wie sie korrekt installiert werden. Diese Anleitung setzt Python 10 und eine GPU mit CUDA-Support voraus. ...